Niniejszy tekst stanowi trzynastą część recenzji książki Jasona Rosenhouse’a, The Failures of Mathematical Anti-Evolutionism, Cambridge University Press, New York 2022, s. 310. Cała recenzja w języku angielskim dostępna jest również na stronie internetowej autora: BillDembski.com.

Mniej więcej do 2007 roku idea zachowania informacji funkcjonowała raczej jak narzędzie kryminalistyczne służące do wykrywania i analizowania przypadków dyskretnego wprowadzenia informacji: Ten i tamten twierdzą, że uzyskali informację za darmo. Sprawdźmy, co naprawdę zrobili. No tak, tutaj właśnie przemycili informację. Około 2007 roku w mojej pracy nad zagadnieniem zachowania informacji doszło jednak do zasadniczego zwrotu. Rozpocząłem poważną współpracę z Robertem Marksem, a nieco później dołączyli do nas dwaj jego bardzo bystrzy studenci. Z początku analizowaliśmy część symulacji ze sztucznym życiem, o których w swojej książce wspomina Jason Rosenhouse, ale także inne (na przykład „ev” Thomasa Schneidera). Jak już wspominałem, odkryliśmy, że informacja uzyskiwana w tych symulacjach zawsze była uprzednio do nich wprowadzana.

Około 2007 roku zaczęliśmy jednak dowodzić twierdzeń pozwalających na precyzyjne prześledzenie informacji w różnych układach oraz ściśle ilościowe ustalenie kosztów informacyjnych. Twierdzenia te pokazują również, że problem informacji nigdy nie staje się łagodniejszy, a niekiedy okazuje się nawet większy, im dalej idzie się wstecz w próbie znalezienia przyczyny powstania rozpatrywanej informacji. Twierdzenia o zachowaniu informacji mówią więc nie tyle, że informacja ulega zachowaniu, ile że w najlepszym razie może ulec zachowaniu i że ilość informacji wymagającej wyjaśnienia, gdy idziemy wstecz w poszukiwaniu jej przyczyny, może w istocie wzrosnąć. Wniosek ten jest ewidentnie niezgodny z darwinizmem, który głosi, że złożoność powstaje z prostoty, nie zaś z równej lub większej złożoności. Zasadniczo twierdzenia o zachowaniu informacji wskazują więc na regres informacyjny, który można zinterpretować na jeden z dwóch sposobów: (1) informacja istnieje od zawsze, od samego początku; lub (2) informację wprowadziła – z zewnątrz – jakaś inteligencja.

Artykuł wiary

Rosenhouse skłania się milcząco ku pierwszej możliwości. Wprawdzie uznaje, że twierdzenia o zachowaniu informacji ostatecznie „jedynie dotyczą tego, dlaczego Wszechświat jest taki, jaki jest”1, ale omawiając zagadnienie sztucznego życia, przyznaje – w zgodzie z twierdzeniami o zachowaniu informacji – że istotna informacja znajduje się nie tylko w algorytmie, lecz także w środowisku2. Jeśli jednak informacja istotna dla ewolucji biologicznej (w odróżnieniu od ewolucji sztucznego życia) jest zawarta w środowisku, to gdzie dokładnie się znajduje i jaką dokładnie ma strukturę? Nie wystarczy powiedzieć – jak Rosenhouse – że „dobór naturalny służy jako kanał do transmitowania informacji środowiskowej do genomów organizmów”3. To po prostu artykuł wiary. Laureat Nagrody Templetona, Holmes Rolston III, który nie jest teoretykiem projektu, kategorycznie odrzuca ten pogląd. Pisząc w książce Genes, Genesis, and God [Geny, pochodzenie i Bóg] o powstaniu informacji, skrytykował pogląd, że informacja istnieje od zawsze:

Informacja (w DNA) jest powiązana z układem tworzącym i przetwarzającym informację (organizmem), który potrafi ją przepisywać, ucieleśniać, metabolizować i powielać. Informacja kiedyś nie istniała, lecz w którymś momencie powstała – to jest miejsce dla kreatywności. Niemniej w trakcie historii ewolucji na Ziemi powstał pewien rezultat. Obejmuje on znaczące osiągnięcia cybernetycznej kreatywności, czyli zasadniczo przyrostowe uzyski informacji, która w trakcie historii ewolucji uległa zachowaniu i skomplikowaniu. Umiejętność – by tak rzec – tworzenia soli zawarta jest już w sodzie i chlorze, ale umiejętność tworzenia cząsteczek hemoglobiny i lemurów nie jest sekretnie zakodowana w węglu, wodorze i azocie4.

A więc nie – informacja nie istnieje od zawsze. I nie – ewolucja darwinowska nie może, zgodnie z twierdzeniami o zachowaniu informacji, tworzyć informacji od zera. Wyjściem z tej kłopotliwej sytuacji jest dla darwinistów (i wielokrotnie widziałem, jak to wyjście stosowali) stwierdzenie, że zachowanie informacji może dotyczyć komputerowych symulacji ewolucji, ale rzeczywista ewolucja ma pewne cechy, które są pomijane w symulacjach. Jeśli jednak tak jest, to jak rzeczywista ewolucja może stanowić przedmiot teorii naukowej, skoro wszelkie próby stworzenia jej modelu jako procesu wyszukiwawczego są nieudane? Twierdzenia o zachowaniu informacji są doskonale ogólne, a więc dotyczą wszystkich takich procesów.

Kiedy przychodzi co do czego

Jak na ironię, Rosenhouse nie powinien móc skorzystać z tego wyjścia, ponieważ – na co wskazywałem w poprzednim poście5 – uważa, że te programy komputerowe „są nie tyle symulacjami ewolucji, ile jej przypadkami”6. Niemniej, kiedy przychodzi co do czego, Rosenhouse nie ma innego wyboru i nawet za cenę niespójności musi postawić na dobór naturalny jako klucz do tworzenia informacji biologicznej. Twierdzenia o zachowaniu informacji wykazują jednak, że dobór naturalny – jeśli ograniczymy się do twierdzeń mających jakiekolwiek naukowe uzasadnienie – jedynie pompuje źródła istniejącej już informacji i nie może stanowić ostatecznego jej wyjaśnienia.

Podobnie jak w przypadku pojęcia wyspecyfikowanej złożoności, dowodząc twierdzeń o zachowaniu informacji, pojęcie w dużej mierze przedteoretyczne przekształciliśmy w pełnoprawne pojęcie teoretyczne. Zgodnie z terminologią Rosenhouse’a przenieśliśmy to pojęcie z toru 1 na tor 27. Obecnie istnieje już dość obszerna literatura specjalistyczna na temat twierdzeń o zachowaniu informacji8.

Spisek milczenia

Rosenhouse nie przytacza tej literatury. W tym względzie idzie on za Wikipedią, gdzie w podhaśle dotyczącym prawa zachowania informacji również nie ma żadnej wzmianki o tych publikacjach. Najnowszą publikacją, do której to podhasło odsyła, jest pochodzący z 2002 roku esej Erika Tellgrena, w którym twierdzi on, że moje twierdzenia o zachowaniu informacji są „pozbawione matematycznego uzasadnienia”9. Jego esej powstał na długo przed udowodnieniem któregokolwiek twierdzenia o zachowaniu informacji. To tak, jakby w latach czterdziestych XX wieku, kiedy rola DNA w procesie dziedziczenia była niejasna, napisano, że twierdzenie o roli DNA w procesie dziedziczenia jest „pozbawione biologicznego uzasadnienia”, i pozostawiono ten wpis nawet po odkryciu struktury DNA (1953) oraz złamaniu kodu genetycznego (1961). Od ukazania się eseju Tellgrena minęło dwadzieścia lat, a mimo to w Wikipedii nadal traktowany jest jako zawierający autorytatywne obalenie prawa zachowania informacji.

Przedstawiona przez Rosenhouse’a krytyka twierdzeń o zachowaniu informacji jest przynajmniej bardziej aktualna niż ujęcie z Wikipedii. Rosenhouse nie przytacza jednak kluczowej literatury i pozostawia ją bez żadnego wyjaśnienia (a gdyby nawet ją przytoczył, to zapewne błędnie by ją zinterpretował). Zwolennicy teorii inteligentnego projektu przywykli już do tego spisku milczenia, w którym wszystko, co stanowi rygorystyczne podważenie darwinizmu, jest zupełnie ignorowane (przypomina to sytuację naszych współczesnych mediów, które podają wybiórcze informacje, koncentrując się wyłącznie na linii partyjnej i pomijając wszystko, co nie pasuje do pożądanej narracji). Czytelnikom niniejszej recenzji mogę wręcz postawić wyzwanie, aby do wspomnianego wyżej podhasła w Wikipedii spróbowali wprowadzić wzmiankę o trzech artykułach, które wymieniłem w przypisie 8. Życzę powodzenia w próbie przejścia przez sito ustawione przez stronniczych redaktorów Wikipedii, którzy trzymają pieczę nad hasłami dotyczącymi teorii inteligentnego projektu.

Czym są więc twierdzenia o zachowaniu informacji? Czytelnicy książki Rosenhouse’a dowiadują się, że takie twierdzenia istnieją, ale Rosenhouse ani nie przedstawia ich sformułowania, ani ich nie streszcza. Jedynymi istotnymi twierdzeniami, które streszcza, są twierdzenia „nic za darmo”, zgodnie z którymi żaden algorytm nie jest lepszy od dowolnego innego algorytmu, jeśli ich działanie uśrednimy w odniesieniu różnych typów krajobrazów przystosowania. Twierdzenia o zachowaniu informacji nie są jednak twierdzeniami „nic za darmo”. Te pierwsze mają zastosowanie tam, gdzie kończy się zastosowanie drugich. Twierdzenia „nic za darmo” mówią, że nie istnieje żaden algorytm wyszukiwania, który byłby uniwersalnie lepszy od innych. Innymi słowy, jeśli jakiś algorytm wyszukiwania dobrze radzi sobie z pewnymi zadaniami, to gorzej wypada przy innych zadaniach. Tym samym twierdzenia „nic za darmo” wskazują na to, że w każdym wyszukiwaniu mamy do czynienia z wymianą o sumie zerowej. Punktem wyjścia twierdzeń o zachowaniu informacji jest natomiast przyznanie, że w przypadku konkretnych wyszukiwań niektóre z nich radzą sobie lepiej od innych, a następnie zadawane jest pytanie, co sprawia, że jeden typ wyszukiwania jest lepszy od innego. Odpowiedzią na to pytanie jest aktywna informacja. Twierdzenia o zachowaniu informacji dostarczają charakterystyki aktywnej informacji.

Zmyślone pojęcie?

Czytając książkę Rosenhouse’a, można pomyśleć, że aktywna informacja jest pojęciem zmyślonym. Jest to jednak pojęcie użyteczne, które wszyscy intuicyjnie rozumiemy, nawet jeśli nie nadajemy mu nazwy. Występuje ono w przypadku wyszukiwań. Wyszukiwanie to bardzo ogólne pojęcie, które obejmuje również proces ewolucji (przypomnijmy sobie, że Rosenhouse charakteryzuje ewolucję właśnie jako „przeszukiwanie przestrzeni białek”). Większość interesujących wyszukiwań jest w zasadzie identyczna do szukania igły w stogu siana. Oznacza to, że istnieją wyszukiwania bazowe, które w zasadzie mogą doprowadzić do znalezienia igły (na przykład wyszukiwanie wyczerpujące lub jednorodne losowe pobieranie prób), ale jej znalezienie byłoby bardzo mało prawdopodobne przy realistycznej ilości czasu. Potrzebne jest więc lepsze wyszukiwanie, czyli takie, dzięki któremu da się znaleźć igłę z większym prawdopodobieństwem, a więc – innymi słowy – aby było prawdopodobne, że przy dostępnym czasie i zasobach rzeczywiście uda się ją znaleźć.

Wszyscy potrafimy rozpoznać aktywną informację. Znajdujesz się na dużym polu. Wiesz, że gdzieś tam jest ukryta pisanka. Wyszukiwanie bazowe na nic się nie zdaje – nie masz realnych szans na znalezienie pisanki. Ktoś jednak podpowiada ci, że jest ciepło, zimno, ciepło, cieplej, gorąco, parzy. Jest to lepsze wyszukiwanie i to dlatego, że otrzymujesz lepsze informacje. Aktywna informacja określa ilość informacji, którą trzeba użyć do ulepszenia wyszukiwania bazowego tak, aby stało się lepszym wyszukiwaniem. Zauważmy, że w naszym przykładzie jest wiele możliwych kierunków, w których mogą podążyć poszukiwacze pisanki. Większość takich kierunków nie doprowadzi jednak do pisanki. Jeśli więc problem znalezienia pisanki jest zasadniczo problemem szukania igły w stogu siana, to taki sam charakter ma wybór kierunków właściwych spośród różnych możliwych kierunków. Aktywna informacja określa koszt informacyjny związany z wyborem właściwych kierunków.

Wyspa skarbów

Rozważmy również podobny przykład poszukiwania skarbu na wyspie. Jeśli wyspa jest duża, a skarb dobrze ukryty, to wyszukiwanie bazowe może się na nic nie zdać – znalezienie skarbu jest zbyt mało prawdopodobne, by istniała na to realna szansa. Przypuśćmy jednak, że masz mapę skarbów, na której X oznacza miejsce, w którym znajduje się skarb. Teraz jest to lepsze wyszukiwanie. Jaki koszt informacyjny wiązał się ze znalezieniem lepszego wyszukiwania? Trzeba było przejrzeć wszystkie możliwe mapy wyspy i znaleźć tę, która wskazuje lokalizację skarbu. Jednak oprócz wszystkich map, na których X oznacza właściwe miejsce, istnieje wiele map, na których X wskazuje na miejsce niewłaściwe. Zgodnie z twierdzeniami o zachowaniu informacji znalezienie właściwej mapy ma prawdopodobieństwo nie większe, a być może mniejsze, niż znalezienie skarbu za pomocą wyszukiwania bazowego. Aktywna informacja określa odpowiednie (nie)prawdopodobieństwo.

Z aktywną informacją spotkaliśmy się już w przypadku algorytmu Richarda Dawkinsa10. Wyszukiwanie bazowe frazy METHINKS IT IS LIKE A WEASEL nie ma żadnych szans na powodzenie. Wymaga uzyskania za jednym razem zupełnie losowego zbioru bezbłędnych uderzeń na klawiaturze we właściwe litery i spację, które występują w tej frazie. Mając jednak funkcję przystosowania, która przypisuje większy stopień przystosowania frazom zawierającym litery pasujące do frazy docelowej METHINKS IT IS LIKE A WEASEL, uzyskujemy lepsze wyszukiwanie, które doprowadzi do frazy docelowej szybko i z dużym prawdopodobieństwem. Większość funkcji przystosowania nie doprowadzi nas jednak choćby nawet w pobliże tej frazy docelowej. Jak więc Dawkins znalazł właściwą funkcję przystosowania, która prowadziła ewolucję w kierunku frazy docelowej? Aby mógł tego dokonać, potrzebna mu była aktywna informacja.

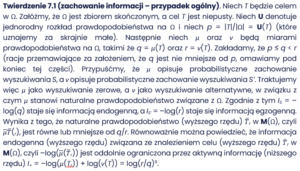

Wraz z moimi kolegami dowiedliśmy różnych twierdzeń o zachowaniu informacji, które mają inna postać w zależności od typu i struktury informacji potrzebnej do otrzymania skutecznego wyszukiwania. Oto najważniejsze twierdzenie o zachowaniu informacji, jakie udało nam się do tej pory dowieść (znajduje się ono w artykule zatytułowanym A General Theory of Information Cost Incurred by Successful Search [Ogólna teoria kosztu informacyjnego związanego ze skutecznym wyszukiwaniem]):

Podsumowanie dyskusji

Chociaż w sformułowaniu tego twierdzenia występuje dużo notacji i dla większości czytelników może być ono niezrozumiałe, podaję je tutaj, ponieważ – pomimo swojej powierzchownej nieczytelności – ma ono pewne cechy, które wszyscy są w stanie zrozumieć, a tym samym może ono być przydatne do podsumowania dyskusji na temat idei zachowania informacji, zwłaszcza w odniesieniu do przeprowadzonej przez Rosenhouse’a krytyki tej koncepcji. Rozważmy więc następujące trzy kwestie:

-

-

-

Pierwsze, co można dostrzec w tym twierdzeniu, jest to, że jest to twierdzenie matematyczne. Znajduje się ono na torze 2 zgodnie z nomenklaturą Rosenhouse’a. Istnieje też recenzowana literatura na ten temat. Twierdzenie to jest oparte na zaawansowanej teorii prawdopodobieństwa, teorii miary i analizie funkcjonalnej. Jego dowód wymaga zastosowania całkowania wektorowego. Jest to analiza rzeczywista wykorzystywana już na poziomie szkoły wyższej. Rosenhouse zajmuje się algebraiczną teorią grafów, a więc nie jest to jego dziedzina i nic nie wskazuje na to, że rzeczywiście rozumie on te twierdzenia. Rezygnuje on z przedstawiania choćby najogólniejszego zarysu matematyki leżącej u podstaw tych twierdzeń, ponieważ „nie jest to istotne dla [jego] celów”11, a także uznaje te twierdzenia za „trywialne rozmyślania”12, co świadczy o tym, że nie radzi on sobie z tą matematyką i nie rozumie jej implikacji, jak również o tym, że jego celem jest obalenie idei zachowania informacji bez względu na jej wartość merytoryczną.

-

Grecka litera μ denotuje wyszukiwanie zerowe, a grecka litera ν denotuje wyszukiwanie alternatywne. Są to – odpowiednio – wyszukiwanie bazowe i lepsze wyszukiwanie, o których pisałem wyżej. Tutaj aktywna informacja, której miarą jest log(r/q), określa informację wymaganą do skutecznego wyszukiwania wyszukiwania (zwykle zapisywanego w skrócie jako „S4S” – od search for a search), czyli informacji potrzebnej do znalezienia ν mającego zastąpić μ. Wyszukiwanie samo może podlegać wyszukiwaniu i to właśnie takie wyszukiwania wyższego rzędu znajdują się w samym sercu twierdzeń o zachowaniu informacji. Należy też zauważyć, że μ i ν nie przesądzają o typach wyszukiwań lub o odpowiadających im prawdopodobieństwach. μ i ν traktowane są jako miary prawdopodobieństwa. Mogą być to jednak dowolne miary prawdopodobieństwa przypisujące celowi T co najmniej takie samo prawdopodobieństwo jak przy przyjęciu jednorodnego rozkładu prawdopodobieństwa (przy założeniu – zupełnie sensownym – że każde wyszukiwanie może mieć przynajmniej taki sam stopień skuteczności jak wyszukiwanie mające jednorodny rozkład prawdopodobieństwa). Oznacza to, że zachowanie informacji nie jest ściśle powiązane z jednorodnym rozkładem prawdopodobieństwa czy równoprawdopodobieństwem. Rosenhouse twierdzi natomiast, że wszystkie matematyczne argumenty teorii inteligentnego projektu opierają się na tym, co nazywa on Podstawowym Argumentem z Nieprawdopodobieństwa i zapisuje w skrócie jako „BAI” (od Basic Argument from Improbability)13. BAI wskazuje na to, że teoretycy projektu stosują najprostszą metodę przypisywania prawdopodobieństw (mianowicie jednorodny rozkład prawdopodobieństwa czy równoprawdopodobieństwo). Tymczasem powyższe twierdzenie o zachowaniu informacji, podobnie jak pojęcie wyspecyfikowanej złożoności, wiąże się z próbą uwzględnienia rzeczywistych prawdopodobieństw. Już samo sformułowanie tego twierdzenia pokazuje, że nie podpada ono pod BAI w sensie Rosenhouse’a.

-

Przestrzeń wyszukiwania Omega (Ω) w twierdzeniu o zachowaniu informacji jest zbiorem skończonym. Jego skończoność w żaden sposób nie przekreśla jednak ogólności tego twierdzenia. We wszystkich badaniach naukowych polegających na ilościowym określaniu fizycznej rzeczywistości używa się liczb i przestrzeni skończonych. W stosowanych modelach matematycznych mogą występować nieskończoności, ale w praktyce zawsze można je zastąpić skończoną aproksymacją. Oznacza to, że modele te należą do dziedziny kombinatoryki. W całej swojej książce Rosenhouse robi uniki, twierdząc, że „kombinatoryka” to brzydkie słowo i że teoria inteligentnego projektu – w tej mierze, w jakiej posługuje się kombinatoryką – koncentruje się na uproszczonych modelach finitystycznych i ogranicza się do jednorodnego rozkładu prawdopodobieństwa czy równoprawdopodobieństwa. To jednak nonsens. Każdy obiekt – matematyczny lub fizyczny – składający się ze skończonej liczby części powiązanych ze sobą na skończoną liczbę sposobów jest obiektem kombinatorycznym. Co więcej, obiekty kombinatoryczne nie dbają o to, jakie przypisuje się im rozkłady prawdopodobieństwa. Maszyny białkowe są obiektami kombinatorycznymi. Programy komputerowe (w tym symulacje ze sztucznym życiem, którymi zauroczony jest Rosenhouse) również są obiektami kombinatorycznymi. Twierdzenia, że teoria inteligentnego projektu szeroko korzysta z kombinatoryki, nie można więc uznać za zasadną krytykę tej teorii.

-

-

William A. Dembski

Oryginał: Conservation of Information – The Theorems, „Evolution News & Science Today” 2022, July 1 [dostęp 21 VII 2023].

Przekład z języka angielskiego: Dariusz Sagan

Źródło zdjęcia: Pixabay

Ostatnia aktualizacja strony: 14.7.2023

Przypisy

- J. Rosenhouse, The Failures of Mathematical Anti-Evolutionism, Cambridge University Press, New York 2022, s. 217.

- Tamże, s. 214.

- Tamże, s. 215.

- H. Rolston III, Genes, Genesis, and God: Values and Their Origins in Natural and Human History: The Gifford Lectures, University of Edinburgh, 1977–1998, Cambridge University Press, Cambridge 1999, s. 352–353 (przyp. tłum.

- W.A. Dembski, Zachowanie informacji – idea, tłum. D. Sagan, „W Poszukiwaniu Projektu” 2023, 14 lipca [dostęp 21 VII 2023] (przyp. tłum.).

- J. Rosenhouse, The Failures of Mathematical Anti-Evolutionism, s. 209.

- Por. W.A. Dembski, Darwinista jako matematyczny policjant: tor 1 i tor 2, tłum. D. Sagan, „W Poszukiwaniu Projektu” 2023, 9 czerwca [dostęp 21 VII 2023] (przyp. tłum.).

- Por. np. trzy ważne recenzowane artykuły (których jestem współautorem) dotyczące tych twierdzeń: W.A. Dembski, R.J. Marks II, Conservation of Information in Search: Measuring the Cost of Success, „IEEE Transactions on Systems, Man and Cybernetics – Part A: Systems and Humans” 2009, Vol. 39, No. 5, s. 1051–1061 [dostęp 27 VII 2022]; W.A. Dembski, R.J. Marks II, The Search for a Search: Measuring the Information Cost of Higher Level Search, „Journal of Advanced Computational Intelligence and Intelligent Informatics” 2010, Vol. 14, No. 5, s. 475–486 [dostęp 27 VII 2022]; W.A. Dembski, W. Ewert, R.J. Marks II, A General Theory of Information Cost Incurred by Successful Search, w: Biological Information: New Perspectives, eds. R.J. Marks II et al., World Scientific, New Jersey – London – Singapore – Beijing – Shanghai – Hong Kong – Taipei – Chennai 2013, s. 26–63 [dostęp 27 VII 2022]. Więcej publikacji dostępnych jest na stronie The Evolutionary Informatics Lab.

- E. Tellgren, On Dembski’s Law of Conservation of Information, „Talk Reason” 2002 [dostęp 27 VII 2022] (przyp. tłum.).

- Por. W.A. Dembski, Zachowanie informacji – idea (przyp. tłum.).

- J. Rosenhouse, The Failures of Mathematical Anti-Evolutionism, s. 212–213.

- Tamże, s. 269.

- Por. tamże, s. 126.

Literatura:

- Dembski W.A., Darwinista jako matematyczny policjant: tor 1 i tor 2, tłum. D. Sagan, „W Poszukiwaniu Projektu” 2023, 9 czerwca [dostęp 21 VII 2023].

- Dembski W.A., Ewert W., Marks II R.J., A General Theory of Information Cost Incurred by Successful Search, w: Biological Information: New Perspectives, eds. R.J. Marks II et al., World Scientific, New Jersey – London – Singapore – Beijing – Shanghai – Hong Kong – Taipei – Chennai 2013, s. 26–63 [dostęp 27 VII 2022].

- Dembski W.A., Marks II R.J., Conservation of Information in Search: Measuring the Cost of Success, „IEEE Transactions on Systems, Man and Cybernetics – Part A: Systems and Humans” 2009, Vol. 39, No. 5, s. 1051–1061 [dostęp 27 VII 2022].

- Dembski W.A., Marks II R.J., The Search for a Search: Measuring the Information Cost of Higher Level Search, „Journal of Advanced Computational Intelligence and Intelligent Informatics” 2010, Vol. 14, No. 5, s. 475–486 [dostęp 27 VII 2022].

- Dembski W.A., Zachowanie informacji – idea, tłum. D. Sagan, „W Poszukiwaniu Projektu” 2023, 14 lipca [dostęp 21 VII 2023].

- Rolston III H., Genes, Genesis, and God: Values and Their Origins in Natural and Human History: The Gifford Lectures, University of Edinburgh, 1977–1998, Cambridge University Press, Cambridge 1999.

- Rosenhouse J., The Failures of Mathematical Anti-Evolutionism, Cambridge University Press, New York 2022.

- Tellgren E., On Dembski’s Law of Conservation of Information, „Talk Reason” 2002 [dostęp 27 VII 2022].